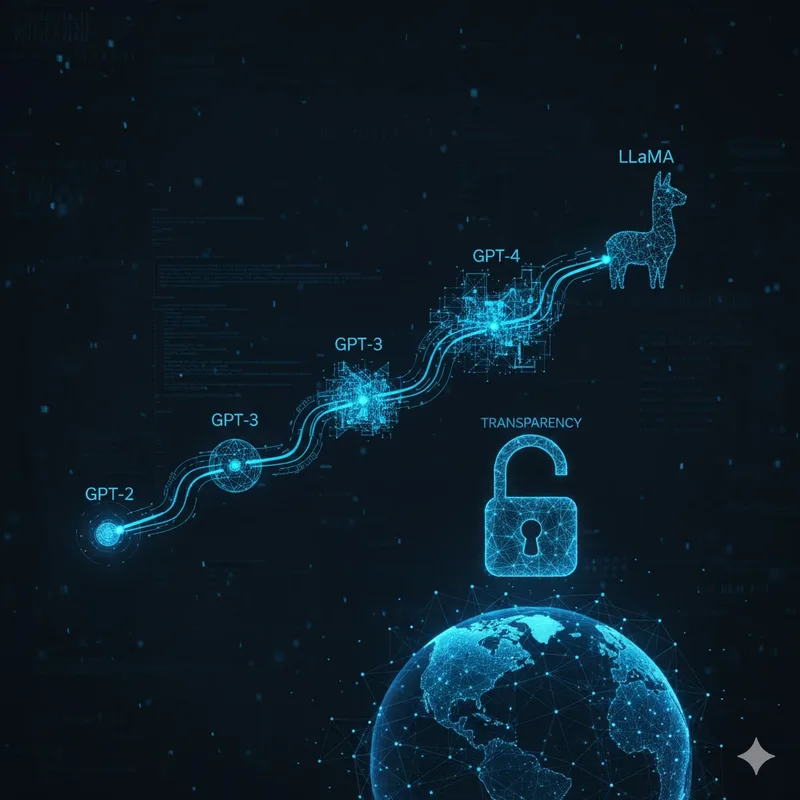

Von GPT-2 bis heute: Wie offene KI-Modelle die Welt verändert haben

1. Der Moment, in dem alles begann

Als OpenAI im Februar 2019 GPT-2 vorstellte, war ich skeptisch. Nicht weil ich die Technologie unterschätzt hätte, sondern weil ich – wie viele andere auch – nicht wirklich verstand, was da gerade passierte. Die Ankündigung war begleitet von einer fast schon theatralischen Warnung: Das Modell sei »zu gefährlich«, um es vollständig zu veröffentlichen. Man sprach von Desinformation, von automatisch generierten Fake-News, von einer Büchse der Pandora, die man lieber geschlossen halten wolle.

Rückblickend war diese Inszenierung vielleicht der beste Marketing-Coup der jüngeren Tech-Geschichte. Aber sie verdeckte etwas Wesentlicheres: GPT-2 war der erste Moment, in dem Sprachmodelle aufhörten, ein akademisches Kuriosum zu sein, und anfingen, etwas zu werden, das man ernst nehmen musste. Nicht weil es perfekt war – es war weit davon entfernt –, sondern weil es zum ersten Mal zeigte, was möglich sein könnte.

Ich erinnere mich noch gut an meine ersten Experimente mit dem kleinen, öffentlich zugänglichen Modell. 124 Millionen Parameter, heute ein Rundungsfehler, damals eine Sensation. Ich gab ihm einen Satzanfang, und es spuckte etwas aus, das auf den ersten Blick wie ein echter Text wirkte. Auf den zweiten Blick zerfiel es oft in Unsinn – Wiederholungen, logische Brüche, Sätze, die ins Nichts führten. Aber dieser erste Blick, dieses kurze Flackern von »das könnte ein Mensch geschrieben haben«, war wie ein Riss in meinem Verständnis davon, was Maschinen können und was nicht.

2. Die Architektur des Umbruchs

Um zu verstehen, warum GPT-2 ein Wendepunkt war, muss man einen Schritt zurücktreten und sich ansehen, was davor kam. Sprachmodelle gab es schon lange – statistische Modelle, die vorhersagten, welches Wort als nächstes kommen könnte. Aber sie waren begrenzt. Sie verstanden keine Zusammenhänge über wenige Wörter hinaus. Sie konnten nicht »denken«, nicht einmal in dem sehr eingeschränkten Sinne, in dem wir dieses Wort heute auf KI anwenden.

Der Durchbruch kam mit der Transformer-Architektur, die Google 2017 in dem Paper »Attention Is All You Need« vorgestellt hatte. Die Idee war elegant: Statt Wörter der Reihe nach zu verarbeiten, sollte das Modell lernen, welche Teile eines Textes füreinander relevant sind – egal wie weit sie voneinander entfernt liegen. »Attention« nannten sie diesen Mechanismus, und der Name war Programm.

GPT-2 war die erste große Demonstration dessen, was passiert, wenn man diese Architektur nimmt, sie mit enormen Textmengen füttert und einfach skaliert. Keine ausgeklügelten Regeln, keine handcodierten Grammatiken. Nur Daten, Rechenleistung und ein Algorithmus, der lernt, das nächste Wort vorherzusagen. Dass daraus etwas entstehen würde, das kohärente Absätze schreiben kann, war für viele – mich eingeschlossen – zunächst schwer zu glauben.

3. Was GPT-2 konnte – und was nicht

Ich habe in jenen frühen Monaten viele Stunden damit verbracht, die Grenzen des Modells auszuloten. Es war wie ein Spiel: Wie lange kann ich es bei der Stange halten, bevor es abdriftet? Die Antwort war meist: nicht sehr lange.

GPT-2 hatte kein Gedächtnis im eigentlichen Sinne. Jeder Prompt war ein Neuanfang. Es konnte keine Fakten zuverlässig wiedergeben, weil es keine Fakten »wusste« – es hatte nur statistische Muster gelernt, die in manchen Fällen zufällig mit der Realität übereinstimmten. Frag es nach dem Geburtsdatum einer berühmten Person, und du bekamst manchmal die richtige Antwort, manchmal eine falsche, manchmal eine erfundene Person gleich mit dazu.

Was mich damals am meisten faszinierte, war nicht das, was es richtig machte, sondern die Art, wie es falsch lag. Die Fehler waren nie zufälliger Buchstabensalat. Sie waren plausibel klingender Unsinn – Sätze, die grammatikalisch einwandfrei waren, aber inhaltlich in eine Parallelwelt führten. Das Modell hatte gelernt, wie Sprache klingt, aber nicht, was sie bedeutet.

4. Der Weg zur Öffnung

OpenAI veröffentlichte GPT-2 in Stufen. Erst das kleine Modell, dann das mittlere, schließlich – nach monatelangem Zögern – das vollständige Modell mit 1,5 Milliarden Parametern. Die befürchtete Apokalypse blieb aus. Die Welt wurde nicht von KI-generierten Fake-News überflutet, jedenfalls nicht mehr als ohnehin schon von menschengemachten.

Was stattdessen passierte, war interessanter: Eine Community entstand. Menschen begannen, mit dem Modell zu experimentieren, es zu verfeinern, auf spezifische Aufgaben anzupassen. Die Veröffentlichung des Codes und der Gewichte ermöglichte etwas, das bei einem geschlossenen System nie möglich gewesen wäre: kollektives Lernen. Tausende von Entwicklern, Forschern und Hobbyisten konnten nachvollziehen, wie das Modell funktionierte, wo seine Schwächen lagen, wie man es verbessern könnte.

Rückblickend war das der eigentliche Wert von GPT-2: nicht das Modell selbst, sondern die Tür, die es öffnete. Es zeigte, dass Sprachmodelle keine Blackbox sein müssen, die nur in den Labors großer Unternehmen existiert. Sie können untersucht, kritisiert, verbessert werden – von jedem, der die Zeit und das Interesse mitbringt.

5. Der Sprung zu GPT-4 und darüber hinaus

Wenn ich heute GPT-4 oder Claude nutze, fühlt sich GPT-2 an wie ein Relikt aus einer anderen Epoche. Die Unterschiede sind nicht graduell, sie sind kategorial. Wo GPT-2 nach wenigen Sätzen den Faden verlor, können moderne Modelle seitenlange, kohärente Texte produzieren. Wo GPT-2 Fakten erfand, können aktuelle Systeme – wenn auch nicht perfekt – auf Wissen zugreifen und Quellen einbeziehen. Wo GPT-2 auf englischsprachige Texte optimiert war, beherrschen heutige Modelle Dutzende von Sprachen mit einer Flüssigkeit, die vor fünf Jahren undenkbar schien.

Die Zahlen sind fast schon absurd: GPT-4 hat schätzungsweise über eine Billion Parameter – das ist mehr als das Sechshundertfache von GPT-2. Aber die reinen Zahlen erzählen nur einen Teil der Geschichte. Wichtiger sind die qualitativen Sprünge: die Fähigkeit, komplexe Anweisungen zu befolgen, Kontext über lange Gespräche hinweg zu behalten, zwischen verschiedenen Aufgaben zu wechseln, Code zu schreiben, der tatsächlich funktioniert.

Was sich nicht geändert hat, ist die grundlegende Architektur. Auch GPT-4 ist im Kern ein Transformer, der das nächste Wort vorhersagt. Die Magie liegt nicht in einer revolutionären neuen Idee, sondern in der Skalierung – mehr Daten, mehr Parameter, mehr Rechenleistung – und in den vielen kleinen Verbesserungen, die sich über die Jahre angesammelt haben: bessere Trainingsdaten, effizientere Algorithmen, Techniken wie RLHF (Reinforcement Learning from Human Feedback), die das Modell dazu bringen, hilfreicher und weniger toxisch zu antworten.

6. Die offene Alternative: Llama und die Demokratisierung

Die Geschichte hätte hier enden können: mit einer Handvoll großer Unternehmen, die immer mächtigere, aber geschlossene Modelle entwickeln, während der Rest der Welt nur über APIs Zugang erhält. Aber dann kam Meta mit Llama.

Als Meta im Februar 2023 die Gewichte von Llama veröffentlichte – zunächst nur für Forscher, dann durch ein Leak für alle –, war das ein Erdbeben. Zum ersten Mal gab es ein Modell, das in derselben Liga spielte wie die kommerziellen Angebote, aber das man herunterladen, auf dem eigenen Rechner laufen lassen und nach Belieben modifizieren konnte.

Die Community explodierte. Innerhalb von Wochen gab es Dutzende von Varianten: Modelle, die auf spezifische Sprachen optimiert waren, Modelle für Code, Modelle, die auf einem MacBook liefen. Menschen fanden Wege, die Modelle zu komprimieren, zu beschleunigen, zu verbessern. Was bei geschlossenen Systemen Jahre gedauert hätte, passierte in Monaten, manchmal in Wochen.

Heute gibt es eine lebendige Landschaft offener Modelle: Llama 3, Mistral, Qwen, Falcon, und viele mehr. Sie sind nicht immer so leistungsfähig wie die besten geschlossenen Modelle, aber der Abstand schrumpft. Und sie bieten etwas, das kein API-Zugang ersetzen kann: Kontrolle. Die Möglichkeit, genau zu wissen, was das Modell tut, wie es trainiert wurde, welche Daten eingeflossen sind. Die Freiheit, es anzupassen, zu erweitern, für eigene Zwecke zu nutzen, ohne von den Geschäftsentscheidungen eines einzelnen Unternehmens abhängig zu sein.

7. Was wir verloren haben – und was wir gewonnen haben

Es wäre naiv zu glauben, dass diese Entwicklung nur positiv ist. Die Demokratisierung von KI bedeutet auch, dass mächtige Werkzeuge in die Hände von Menschen gelangen, die sie missbrauchen wollen. Deepfakes werden überzeugender, Spam-Bots intelligenter, Desinformation schwerer zu erkennen. Die Bedenken, die OpenAI 2019 bei der Veröffentlichung von GPT-2 äußerte, waren nicht aus der Luft gegriffen – sie haben sich nur anders materialisiert, als damals befürchtet.

Gleichzeitig hat die Offenheit etwas ermöglicht, das bei geschlossenen Systemen unmöglich wäre: Transparenz und Rechenschaftspflicht. Wenn ein offenes Modell problematische Inhalte produziert, kann jeder nachvollziehen, warum. Wenn es Vorurteile zeigt, können Forscher die Trainingsdaten analysieren und Verbesserungen vorschlagen. Die Community kann Probleme identifizieren und lösen, statt darauf zu warten, dass ein Unternehmen sie ernst nimmt.

8. Ein persönlicher Rückblick

Wenn ich heute auf die fünf Jahre seit GPT-2 zurückblicke, ist das Gefühl ähnlich wie bei anderen technologischen Umbrüchen, die ich erlebt habe: eine Mischung aus Staunen, Unbehagen und der Erkenntnis, dass die Welt sich verändert hat, ob man es wollte oder nicht.

Was mich am meisten beeindruckt, ist nicht die rohe Leistungsfähigkeit der aktuellen Modelle – so beeindruckend sie auch ist –, sondern die Geschwindigkeit, mit der sich das Feld entwickelt. Als ich 2019 mit GPT-2 experimentierte, fühlte sich die Idee eines KI-Assistenten, der komplexe Aufgaben erledigen kann, noch wie Science-Fiction an. Heute ist sie Alltag, für Millionen von Menschen.

Gleichzeitig bleibt vieles ungelöst. Die Modelle halluzinieren immer noch, erfinden Fakten, machen Fehler. Sie verstehen die Welt nicht wirklich – sie simulieren nur Verständnis, auf eine Weise, die mal mehr, mal weniger überzeugend ist. Die Fragen nach Urheberrecht, nach Arbeitsplätzen, nach der Konzentration von Macht in den Händen weniger Unternehmen sind drängender denn je.

Aber eines hat sich seit 2019 grundlegend geändert: Wir sind nicht mehr nur Zuschauer. Mit offenen Modellen, mit Tools, die jeder nutzen kann, mit einer Community, die Wissen teilt und Grenzen auslotet, haben wir die Möglichkeit, diese Technologie mitzugestalten. Nicht als passive Konsumenten, sondern als aktive Teilnehmer.

Das ist vielleicht das wichtigste Erbe von GPT-2: nicht das Modell selbst, sondern die Idee, dass KI keine Blackbox sein muss. Dass wir verstehen können, wie sie funktioniert. Dass wir sie kritisieren, verbessern und für unsere eigenen Zwecke nutzen können. Diese Idee ist heute lebendiger denn je – und das gibt mir, trotz aller Bedenken, Hoffnung für das, was kommt.

Dies ist der erste Artikel einer Serie über die Geschichte und Zukunft offener KI-Modelle. In den kommenden Wochen werden wir tiefer in einzelne Themen eintauchen: von der technischen Funktionsweise von Transformern über die Ethik des Trainings bis hin zu praktischen Anleitungen, wie man offene Modelle selbst nutzen kann.

Voice AI: Die Renaissance der Sprachassistenten

ElevenLabs, GPT-4o Voice, Alexa+: Wie neue Voice-AI-Technologie Sprachassistenten transformiert und

Der überraschende Sprung: Claude Opus 4.5 und die Zukunft des Programmierens

Ein erfahrener Entwickler testet Claude Opus 4.5 beim Refactoring und Code-Review. Wie das neue Mode