KI in der Wissenschaft: Wie künstliche Intelligenz Forschung revolutioniert

Im Oktober 2024 erhielten Demis Hassabis und John Jumper von Google DeepMind den Nobelpreis für Chemie für ihre Arbeit an AlphaFold. Fünf Jahre zuvor hatte AlphaFold 2 das Proteinstruktur-Vorhersage-Problem gelöst, eine Herausforderung, die Biologen seit 50 Jahren beschäftigt hatte. Heute nutzen über 3 Millionen Forscher in mehr als 190 Ländern die AlphaFold-Datenbank mit über 200 Millionen Proteinstruktur-Vorhersagen. Es war der Beweis: KI kann ein mächtiges Werkzeug sein, um die Wissenschaft voranzubringen.

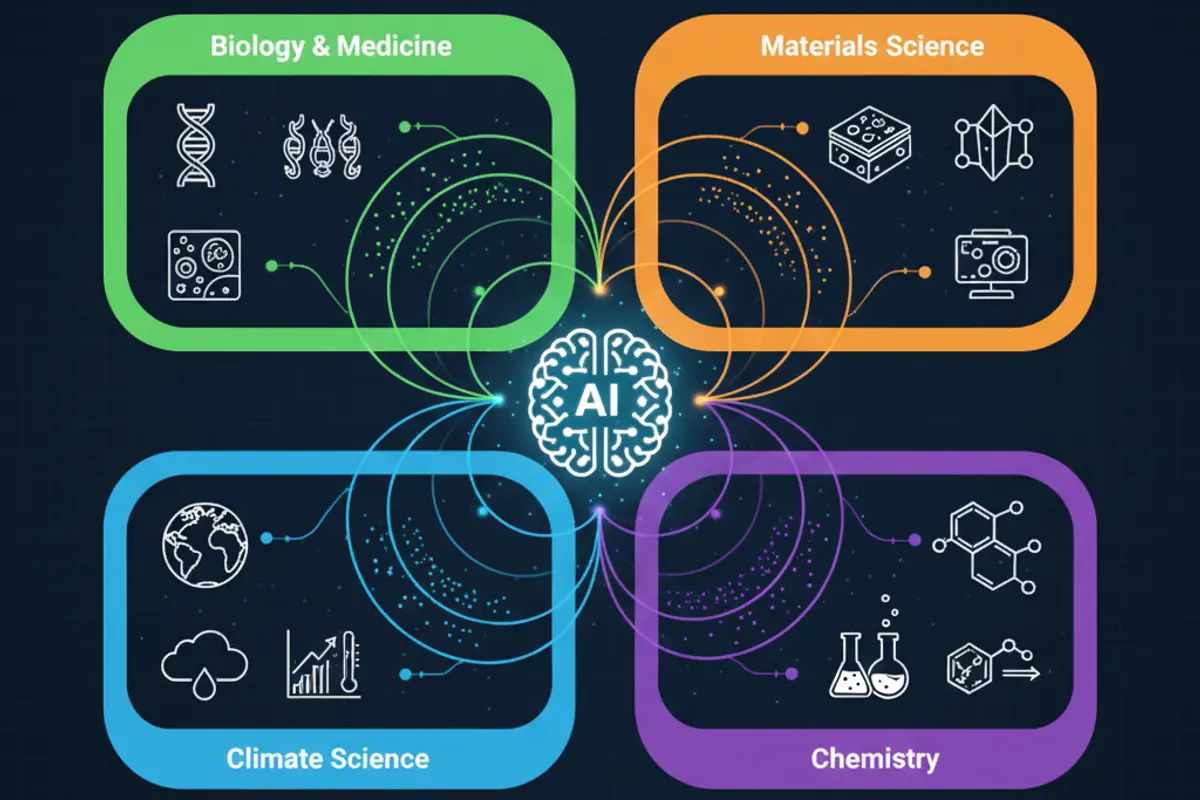

2025 zeigt sich, dass AlphaFold kein Einzelfall war. Von der Medikamentenentwicklung über die Materialwissenschaft bis zur Klimaforschung beschleunigt KI die wissenschaftliche Entdeckung in einer Weise, die vor wenigen Jahren noch undenkbar schien. Google selbst fasst das Jahr zusammen: »Ein Jahr der KI-Agenten, des Reasonings und der wissenschaftlichen Entdeckung.«

Der KI-Co-Wissenschaftler

Google hat 2025 den »AI Co-Scientist« veröffentlicht, ein Multi-Agenten-KI-System, das Wissenschaftlern hilft, neue Hypothesen zu generieren. An der Stanford University half das System, Medikamente zu identifizieren, die für die Behandlung von Leberfibrose umgewidmet werden könnten. Am Imperial College London reproduzierte es in zwei Tagen eine Hypothese, für deren Entwicklung das Forscherteam Jahre gebraucht hatte.

Das Konzept des KI-Co-Wissenschaftlers verbreitet sich. FutureHouse, ein gemeinnütziges KI-Forschungslabor mit der Mission, einen »KI-Wissenschaftler« zu bauen, hat eine Open-Access-Plattform mit spezialisierten LLM-Agenten entwickelt: Crow, Falcon, Owl und Phoenix, jeweils auf unterschiedliche Phasen des Forschungsworkflows in Biologie und Chemie zugeschnitten.

Die Vision geht noch weiter. Lila Sciences, eines der neuesten KI-Unicorns mit Hunderten Millionen Dollar Finanzierung, baut Labore, in denen KI-Agenten Experimente planen, durchführen und interpretieren. Das Ziel: »Wissenschaftliche Superintelligenz.«

Medikamentenentwicklung: Der Stresstest

Die Biotechnologie-Industrie bereitet sich auf 2026 als »Stresstest« für KI in der Medikamentenentwicklung vor. Mehrere KI-entdeckte Wirkstoffkandidaten erreichen mittlere bis späte klinische Studienphasen, mit Schwerpunkt auf Onkologie und seltene Erkrankungen.

Die Zahlen verdeutlichen, warum das wichtig ist: Die Entwicklung eines neuen Medikaments vom Konzept bis zur Klinik dauert durchschnittlich 10 Jahre, kostet über 2,5 Milliarden Dollar und hat eine Ausfallrate von 90 Prozent in präklinischen und klinischen Phasen. KI verspricht, jeden dieser Parameter zu verbessern.

Im Oktober 2025 beschrieben Forscher das BoltzGen-Modell, das Nano-Antikörper gegen Proteine entwerfen kann, die bei Krebs, viralen und bakteriellen Infektionen und anderen Krankheiten eine Rolle spielen. In den meisten Fällen identifizierten sie Antikörper mit starker Zielbindung nach der Expression von nur 15 der vielversprechendsten Designs. KI-generierte Antikörper wurden kürzlich von menschlichen Immunzellen toleriert, klinische Studien stehen bevor.

Das US-amerikanische FDA hat im Juli 2025 angekündigt, sein ISTAND-Pilotprogramm in ein permanentes Drug Development Tool Qualification Program zu überführen, das digitale Gesundheitstechnologien wie KI-basierte Algorithmen einschließt.

Materialwissenschaft: Das selbstfahrende Labor

In der Materialwissenschaft hat MIT die »CRESt«-Plattform entwickelt, ein KI-System, das aus verschiedenen wissenschaftlichen Informationstypen lernt und Experimente durchführt, um neue Materialien zu entdecken. In drei Monaten erforschte CRESt über 900 Chemien und entdeckte einen Acht-Elemente-Katalysator, der eine 9,3-fache Verbesserung der Leistungsdichte pro Dollar gegenüber reinem Palladium erreichte und einen neuen Rekord für Direktformat-Brennstoffzellen setzte.

Das Argonne National Laboratory hat Polybot entwickelt, ein KI-gesteuertes automatisiertes Materiallabor, das Verarbeitungswege erkundet, um hochwertige elektronische Polymerfilme mit optimierter Leitfähigkeit herzustellen. Ein Durchbruch in der Laborautomatisierung: Ein selbstfahrendes Labor sammelt zehnmal mehr Daten als herkömmliche Methoden und beschleunigt den Fortschritt drastisch.

In Japan haben die Tohoku University und Fujitsu mit KI neue Erkenntnisse über Supraleitungsmechanismen für ein neues supraleitendes Material gewonnen: Cäsium-Vanadium-Antimonid (CsV3Sb5), ein Kagome-Supraleiter mit Potenzial als Hochtemperatur-Supraleiter.

Klima und Wetter: Tausend Jahre in einem Tag

Die NOAA hat 2025 eine neue Suite von KI-gesteuerten globalen Wettervorhersagemodellen eingeführt. Das AIGFS-Modell (Artificial Intelligence Global Forecast System) liefert verbesserte Wettervorhersagen schneller und effizienter. Eine einzelne 16-Tage-Vorhersage benötigt nur 0,3 Prozent der Rechenressourcen des operativen GFS und ist in etwa 40 Minuten fertig.

University of Washington-Forscher haben mit dem DLESyM-Modell das Erdklima und die interannuelle Variabilität für bis zu 1.000 Jahre simuliert. Das Modell läuft auf einem einzelnen Prozessor und braucht nur 12 Stunden für eine Vorhersage, für die ein Supercomputer etwa 90 Tage bräuchte. Es simuliert tropische Wirbelstürme und den saisonalen Zyklus des indischen Sommermonsuns besser als die CMIP6-Modelle.

Für die Vorhersage extremer Wetterereignisse kombinieren Forscher KI mit konventionellen Klimamodellen. Ein Hybrid aus Huaweis Pangu-Weather-KI-Modell mit einem physikbasierten globalen Klimamodell kann Hitzewellen schneller vorhersagen als das Standardmodell allein.

Chemie: Hunderte Versuche gespart

In der Chemie hat eine feinabgestimmte Version von Metas Llama-LLM optimale Bedingungen für eine zuvor nicht dokumentierte komplexe Reaktion in nur 15 experimentellen Durchläufen identifiziert und den Forschern Hunderte von Versuchen erspart. Das System »lernte« dabei nicht nur aus Textdaten, sondern aus der Integration verschiedener wissenschaftlicher Informationsquellen.

AlphaFold 3, angekündigt im Mai 2024 und von Google DeepMind und Isomorphic Labs gemeinsam entwickelt, geht über einzelne Proteine hinaus. Es kann die Strukturen von Proteinkomplexen mit DNA, RNA, posttranslationalen Modifikationen und ausgewählten Liganden und Ionen vorhersagen. Im Gegensatz zu AlphaFold 2, das auf vorlagenbasierten Methoden beruhte, führt der fortgeschrittene Algorithmus ein diffusionsbasiertes Modell ein.

Die Open-Source-Community holt auf: OpenFold3, ein neues Open-Source-KI-Modell, das 3D-Strukturen von Proteinen vorhersagt, nähert sich der Leistung von AlphaFold 3.

Die Grenzen

Trotz der Erfolge mahnen Forscher zur Vorsicht. Eine MIT-Studie zeigt, dass einfachere Modelle bei der Schätzung regionaler Oberflächentemperaturen genauer sein können als Deep-Learning-Ansätze, während Letztere bei der Schätzung lokaler Niederschläge die beste Wahl sein können. Die Forscher sehen ihre Arbeit als »warnendes Beispiel« für das Risiko, große KI-Modelle unkritisch in der Klimawissenschaft einzusetzen.

In der Materialwissenschaft bleiben Herausforderungen: Modellgeneralisierbarkeit, standardisierte Datenformate, experimentelle Validierung und Energieeffizienz. Hybridansätze, die physikalisches Wissen mit datengetriebenen Modellen kombinieren, gelten als vielversprechendster Weg.

Und die Frage der Reproduzierbarkeit: Eine unabhängige Analyse zeigt, dass Forscher, die AlphaFold 2 nutzen, einen Anstieg von über 40 Prozent bei der Einreichung neuartiger experimenteller Proteinstrukturen verzeichnen. Aber wie zuverlässig sind KI-generierte Hypothesen, die noch nicht experimentell validiert wurden?

Die neue wissenschaftliche Methode

Die wissenschaftliche Methode selbst wird neu definiert. KI-Agenten planen Experimente, steuern Robotik und analysieren die riesigen Datenmengen, die produziert werden. Das US-Energieministerium hat die Genesis Mission angekündigt, einen historischen Vorstoß, um amerikanische Wissenschaft und Innovation durch KI zu transformieren.

Die Frage ist nicht mehr, ob KI die Wissenschaft verändern wird, sondern wie schnell und wie fundamental. Die Releases im Dezember 2025 zeigen, dass die KI-Industrie nicht nur inkrementelle Verbesserungen vornimmt, sondern grundlegend überdenkt, wie KI-Systeme gebaut werden. Die Wissenschaft profitiert davon zuerst und am meisten.