KI-Suche: Perplexity, SearchGPT und das Ende von Google?

Es gibt einen Moment, den jeder erlebt, der zum ersten Mal eine KI-Suchmaschine benutzt: Man stellt eine Frage, und statt einer Liste blauer Links erhält man eine direkte Antwort, formuliert wie von einem sachkundigen Gesprächspartner, mit Quellenangaben neben jedem Fakt. In diesem Moment fragt man sich unweigerlich: Warum habe ich jemals anders gesucht?

Google dominiert die Internetsuche seit über zwei Jahrzehnten mit einem Marktanteil, der lange bei über 90 Prozent lag. Doch Ende 2024 fiel dieser Wert erstmals seit Jahren unter die magische Marke, und seitdem pendelt er bei etwa 89 bis 90 Prozent. Das klingt nach einer marginalen Verschiebung, doch in einem Markt mit über 8,5 Milliarden Suchanfragen täglich bedeuten selbst kleine Prozentpunkte Millionen von Nutzern, die sich anders orientieren.

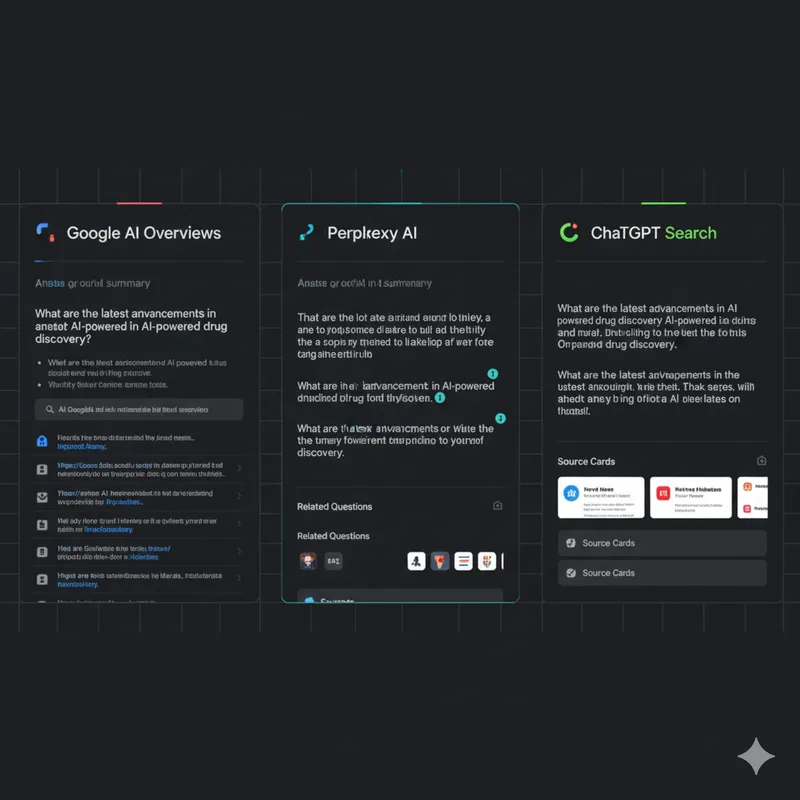

Die Herausforderer heißen Perplexity, ChatGPT Search und eine wachsende Zahl spezialisierter KI-Assistenten. Sie versprechen nicht weniger als eine fundamentale Neuerfindung dessen, wie wir Informationen im Internet finden. Doch können sie dieses Versprechen wirklich einlösen, oder erleben wir nur eine weitere Technologie-Euphorie, die sich in einigen Jahren als übertrieben herausstellen wird?

Die neuen Spieler: Wer fordert Google heraus?

ChatGPT dominiert den KI-Markt mit einem Anteil von etwa 78 Prozent aller KI-Suchverweise, gefolgt von Perplexity mit rund 15 Prozent und Googles eigenem Gemini mit etwa 6 Prozent. Die Zahlen verdeutlichen eine interessante Dynamik: OpenAIs ChatGPT, ursprünglich als Chatbot konzipiert, hat sich zur meistgenutzten KI-Suchmaschine entwickelt, während Perplexity, das von Anfang an als »Antwortmaschine« positioniert wurde, eine loyale Nutzerbasis aufgebaut hat, die besonders Wert auf Quellenangaben legt.

ChatGPT Search, das im Oktober 2024 offiziell als Integration von SearchGPT in ChatGPT eingeführt wurde, verarbeitet mittlerweile über zwei Milliarden Anfragen täglich und erreicht mehr als 700 Millionen wöchentlich aktive Nutzer. Die Technologie basiert auf einer optimierten Version von GPT-4o, die durch Destillation des o1-Modells verfeinert wurde, um präzisere und aktuellere Antworten zu liefern. Mit der Einführung von GPT-5 hat OpenAI die Halluzinationsrate bei aktivierter Websuche um etwa 45 Prozent gegenüber GPT-4o reduziert.

Perplexity hingegen hat sich als Spezialist für quellenbasierte Recherche etabliert. Das Unternehmen verarbeitet mittlerweile 780 Millionen Anfragen pro Monat, ein Wachstum von 524 Prozent innerhalb eines Jahres. Was Perplexity auszeichnet, ist die konsequente Integration von Quellenverweisen direkt im Antworttext: Jede Behauptung ist mit einem klickbaren Link versehen, sodass Nutzer sofort überprüfen können, woher eine Information stammt. In unabhängigen Tests erreichte Perplexity eine Genauigkeit von 88 Prozent bei allgemeinen Wissensfragen, während ChatGPT auf 82 Prozent kam.

Wie sich die KI-Suche von der klassischen Suche unterscheidet

Der fundamentale Unterschied liegt nicht in der Technologie, sondern in der Philosophie. Google zeigt eine Liste von Webseiten, die möglicherweise die gesuchte Information enthalten; der Nutzer muss selbst entscheiden, welche Quelle vertrauenswürdig ist, und die relevanten Passagen finden. KI-Suchmaschinen synthetisieren die Informationen aus mehreren Quellen und präsentieren eine zusammenhängende Antwort. Das spart Zeit, verschiebt aber auch die Verantwortung: Der Nutzer vertraut darauf, dass die KI die richtigen Quellen ausgewählt und korrekt zusammengefasst hat.

Google selbst reagiert auf diese Herausforderung mit AI Overviews, einer Funktion, die KI-generierte Zusammenfassungen über den klassischen Suchergebnissen anzeigt. Nach einer volatilen Einführungsphase erscheinen diese Zusammenfassungen mittlerweile bei etwa 15 bis 25 Prozent aller Suchanfragen, mit Spitzenwerten von bis zu 47 Prozent bei bestimmten Fragetypen. Die Reaktionen sind gemischt: Während Nutzer die schnellen Antworten schätzen, beklagen Publisher einen dramatischen Rückgang des Traffics.

Studien zeigen, dass die Klickrate auf organische Suchergebnisse um 34 bis 61 Prozent sinkt, wenn AI Overviews angezeigt werden. Eine Analyse des Pew Research Centers ergab, dass Nutzer bei Vorhandensein von KI-Zusammenfassungen nur noch in 8 Prozent der Fälle auf ein Suchergebnis klicken, verglichen mit 15 Prozent ohne diese Zusammenfassungen. Der Anteil der sogenannten »Zero-Click-Suchen«, bei denen Nutzer Google verlassen, ohne eine Website zu besuchen, ist auf etwa 69 Prozent gestiegen.

Das Problem der Genauigkeit

Die bequeme Antwort kommt mit einem Preis: der Frage nach der Zuverlässigkeit. Eine Studie der Columbia University ergab, dass KI-Chatbots in mehr als der Hälfte der Fälle nicht die korrekten Artikel abrufen konnten und generell schlecht darin waren, Fragen abzulehnen, die sie nicht akkurat beantworten konnten. Besonders beunruhigend: Trotz mangelhafter Ergebnisse antworteten die KI-Systeme mit »alarmierender Selbstsicherheit« und verwendeten selten einschränkende Formulierungen.

Die Fehlerquoten variieren stark zwischen den Plattformen. In einer Untersuchung von Wordstream aus dem Juli 2025 wiesen 26 Prozent der Google AI Overview-Antworten zu Themen der Online-Werbung Fehler auf, während Perplexity bei 13 Prozent lag. Eine andere Studie fand, dass Perplexity 37 Prozent der Anfragen fehlerhaft beantwortete, während Grok 3 von xAI eine erschreckende Fehlerquote von 94 Prozent aufwies.

Das grundlegende Problem ist nicht neu: KI-Modelle »halluzinieren«, sie generieren plausibel klingende, aber faktisch falsche Informationen. Anthropic hat in seiner Interpretierbarkeitsforschung interne Schaltkreise identifiziert, die Claude dazu bringen sollten, Fragen abzulehnen, wenn das Modell die Antwort nicht kennt. Halluzinationen treten auf, wenn diese Hemmung fehlerhaft arbeitet, etwa wenn Claude einen Namen erkennt, aber nicht genügend Informationen über die betreffende Person hat.

Ein besonders prominentes Beispiel aus dem Jahr 2025: Mehrere von Deloitte erstellte Berichte für Regierungen in Australien und Kanada enthielten KI-generierte Halluzinationen, darunter nicht existierende akademische Quellen und ein erfundenes Zitat aus einem Gerichtsurteil. Die Unternehmen mussten Teilrückerstattungen leisten. Solche Fälle untergraben das Vertrauen in KI-gestützte Recherche und zeigen, dass menschliche Überprüfung nach wie vor unerlässlich ist.

Die Perspektive der Publisher

Für Verlage und Content-Ersteller ist die KI-Suche ein zweischneidiges Schwert. Eine Umfrage von Digital Content Next ergab, dass der mediane Rückgang des von Google verwiesenen Traffics im Mai und Juni 2025 bei 10 Prozent lag, mit 7 Prozent für Nachrichtenmarken und 14 Prozent für andere Inhalte. Einzelne Fälle sind drastischer: Die Daily Mail berichtete von Rückgängen der Klickrate von bis zu 89 Prozent bei bestimmten Themen, und die Lernplattform Chegg verzeichnete einen Rückgang des Nicht-Abonnenten-Traffics um 49 Prozent.

Die rechtliche Dimension ist komplex. Eine Gruppe großer US-amerikanischer Zeitungen, darunter die Chicago Tribune und die New York Daily News, hat Klage gegen OpenAI und Microsoft eingereicht und behauptet, ihre urheberrechtlich geschützten Artikel seien illegal zum Training von KI-Modellen verwendet worden. Das US Copyright Office hat angedeutet, dass urheberrechtlich geschütztes Material nur in »begrenztem Umfang« für Training verwendet werden darf, wobei »weitreichendes Scraping« nicht erlaubt sei.

Einige Technologieunternehmen haben versucht, durch Lizenzvereinbarungen formelle Beziehungen zu Verlagen aufzubauen. Doch eine Studie ergab, dass diese Vereinbarungen keine Garantie für akkurate Zitierung in Chatbot-Antworten bieten. Die Frage, wie die Wertschöpfung in einer Welt verteilt werden soll, in der KI Inhalte synthetisiert, anstatt Nutzer direkt zu den Quellen zu leiten, bleibt ungelöst.

Die Situation in Deutschland

Deutschland nimmt mit einem KI-Bereitschaftsindex von 76,63 den achten Platz weltweit ein und führt Europa bei der industriellen KI-Adoption. Allerdings fehlt dem Land ein eigenes Frontier-Modell, und die Investitionen in KI-Infrastruktur bleiben hinter anderen Ländern zurück. Laut OECD-Schätzungen betrug die private Investition in KI-Rechenkapazität in Deutschland 2024 lediglich 54 Millionen Dollar, verglichen mit fast 2 Milliarden Dollar in Kanada.

Die KI-Nutzung in deutschen Unternehmen stagniert überraschend. Eine Studie des ZEW im Auftrag des Bundeswirtschaftsministeriums ergab, dass die KI-Nutzung seit 2021 nur um einen Prozentpunkt gestiegen ist. Die höchste Adoptionsrate findet sich in IT-Dienstleistungen mit 42 Prozent, gefolgt von Rechts- und Steuerberatung mit 36 Prozent. Deutschland liegt damit über dem EU-Durchschnitt von 8 Prozent, fällt aber im Vergleich zu Ländern wie Dänemark, Finnland und den Niederlanden zurück.

Eine YouGov-Studie aus dem Jahr 2025 zeigt zudem eine deutliche demografische Kluft: Jüngere Deutsche führen bei der Adoption, während erhebliche Teile der Bevölkerung von generativer KI abgekoppelt bleiben. Diese Unterschiede verlaufen entlang von Altersgruppen, Geschlecht und Bildungsniveau. Ohne eigene Frontier-Modelle sind deutsche Nutzer und Unternehmen weitgehend auf amerikanische Systeme wie GPT, Gemini und Llama angewiesen.

Prognosen für die Zukunft

Die Vorhersagen reichen von konservativ bis revolutionär. Gartner prognostiziert, dass das traditionelle Suchvolumen bis 2026 um 25 Prozent sinken wird, da Nutzer verstärkt auf generative KI-Assistenten zurückgreifen. Das würde bedeuten, dass Googles Anfragevolumen von etwa 14 Milliarden täglich auf 10 bis 11 Milliarden fallen könnte.

Andere Analysten sehen einen längeren Horizont. Der Branchenanalyst Kevin Indig modelliert, dass ChatGPTs Traffic den von Google um etwa Oktober 2030 überholen könnte. Basierend auf Similarweb-Daten von Mitte 2025 generiert Google Search etwa 136 Milliarden monatliche Besuche, verglichen mit etwa 4 Milliarden für ChatGPT. Wenn das aktuelle Wachstum anhält, könnten LLM-basierte Systeme bis 2030 über 50 Prozent des globalen Suchvolumens ausmachen.

Allerdings gibt es auch skeptische Stimmen. Trotz aller Prognosen über Googles Niedergang zeigen aktuelle Daten, dass der Suchgigant einen Marktanteil von etwa 95 Prozent hält, während KI-Tools nur 1,3 Prozent der Browser-Aktivität ausmachen. Die KI-Revolution in der Suche, so diese Perspektive, fühlt sich eher wie eine sanfte Evolution an als die dramatische Disruption, die die Schlagzeilen suggerieren.

Was bedeutet das für Nutzer?

Die praktische Empfehlung ist differenziert: Verschiedene Werkzeuge für verschiedene Aufgaben. Perplexity eignet sich besonders für Recherchen, bei denen Quellenangaben wichtig sind, etwa für akademische Arbeiten oder Faktenprüfung. ChatGPT Search ist stark bei der Synthese komplexer Themen und Folgefragen im Konversationsstil. Google bleibt unübertroffen für lokale Suchen, Shopping, Bildsuche und Anfragen, bei denen man eine breite Auswahl an Quellen sehen möchte.

Die wichtigste Fähigkeit im Zeitalter der KI-Suche ist kritisches Denken. Nur weil eine KI eine Antwort selbstsicher präsentiert, bedeutet das nicht, dass sie korrekt ist. Die Überprüfung von Quellen, das Hinterfragen von Behauptungen und ein gesundes Maß an Skepsis sind wichtiger denn je. Ironischerweise erfordert die Nutzung von Werkzeugen, die uns das Denken abnehmen sollen, mehr eigenes Denken, nicht weniger.

Fazit: Evolution, nicht Revolution

Ist Google am Ende? Die ehrliche Antwort lautet: wahrscheinlich nicht, zumindest nicht in absehbarer Zeit. Aber Google, wie wir es kannten, verändert sich unwiderruflich. Das Unternehmen integriert selbst massiv KI in seine Produkte, von AI Overviews bis zum neuen AI Mode. Die Frage ist nicht, ob KI die Suche transformiert, sondern wie schnell und wie fundamental.

Für Nutzer bedeutet das mehr Auswahl und mehr Verantwortung. Die blauen Links werden nicht verschwinden, aber sie werden zunehmend von KI-generierten Zusammenfassungen ergänzt oder ersetzt. Die Herausforderung besteht darin, die neuen Werkzeuge klug zu nutzen, ihre Stärken auszuschöpfen und ihre Schwächen zu erkennen. Die Zukunft der Suche ist nicht die Herrschaft einer einzelnen Plattform, sondern ein Ökosystem verschiedener Werkzeuge für verschiedene Bedürfnisse. Wir stehen erst am Anfang dieser Transformation.