KI-Kosten und Umwelt: Der versteckte Preis der künstlichen Intelligenz

Als OpenAI GPT-4 trainierte, kostete das über 100 Millionen Dollar und verbrauchte 50 Gigawattstunden Energie, genug um San Francisco drei Tage lang mit Strom zu versorgen. Das war nur das Training. Jede einzelne Anfrage an ChatGPT verbraucht zusätzlich Energie. Und bei geschätzten 11 Millionen Anfragen pro Stunde summiert sich das: Die jährlichen CO2-Emissionen einer ChatGPT-ähnlichen Anwendung betragen etwa 12.800 Tonnen, 25-mal so viel wie das Training von GPT-3.

Die KI-Revolution hat einen Preis, der selten auf der Rechnung steht. Eine aktuelle Studie schätzt, dass KI-Systeme 2025 einen CO2-Fußabdruck zwischen 32,6 und 79,7 Millionen Tonnen haben könnten, vergleichbar mit den Gesamtemissionen von New York City. Und der Wasserverbrauch? Zwischen 312,5 und 764,6 Milliarden Liter, in etwa so viel wie der weltweite jährliche Konsum von Flaschenwasser.

Die Zahlen hinter dem Boom

Weltweit verbrauchten Rechenzentren 2024 geschätzte 415 Terawattstunden Strom, etwa 1,5 Prozent des globalen Stromverbrauchs. In den USA waren es 183 Terawattstunden, mehr als 4 Prozent des nationalen Verbrauchs, ungefähr so viel wie Pakistan im Jahr verbraucht.

KI ist derzeit für 5 bis 15 Prozent des Rechenzentrums-Energieverbrauchs verantwortlich. Bis 2030 könnte dieser Anteil auf 35 bis 50 Prozent steigen. Die Internationale Energieagentur prognostiziert, dass sich der globale Stromverbrauch von Rechenzentren bis 2030 auf 945 Terawattstunden verdoppeln wird.

In Irland, einem europäischen Tech-Hub, verbrauchen Rechenzentren bereits 21 Prozent des nationalen Stroms, mit Prognosen von 32 Prozent bis 2026. In Dublin liegt der Anteil bei 79 Prozent. In Virginia nutzen Rechenzentren 26 Prozent der Elektrizität, und eine Carnegie-Mellon-Studie schätzt, dass Rechenzentren und Krypto-Mining die durchschnittliche US-Stromrechnung bis 2030 um 8 Prozent erhöhen könnten, in Virginias Hochnachfrage-Märkten um über 25 Prozent.

Training versus Nutzung

Ein verbreitetes Missverständnis: Das Training großer Modelle ist der Hauptenergieverbraucher. Tatsächlich macht die Inferenz, also die tägliche Nutzung trainierter Modelle, 80 bis 90 Prozent der gesamten Lebenszykluskosten aus. Während das Training ein einmaliger Energiespike ist, ist die Inferenz eine lange, stetige Kurve, die das Training über die Lebensdauer eines Modells übertreffen kann.

Die gute Nachricht: Inferenzkosten sinken rapide. Stanfords AI Index Report 2025 zeigt, dass die Inferenzkosten für ein System auf GPT-3.5-Niveau zwischen November 2022 und Oktober 2024 um das 280-fache gefallen sind. DeepSeek V3, veröffentlicht im Januar 2025, erreichte GPT-4-Niveau für nur 5,6 Millionen Dollar, weniger als 5 Prozent dessen, was US-Konkurrenten ausgaben.

Die schlechte Nachricht: Der Inferenzmarkt wird von 106 Milliarden Dollar 2025 auf 255 Milliarden Dollar 2030 wachsen. Mehr Effizienz bedeutet oft mehr Nutzung, nicht weniger Gesamtverbrauch.

Die Infrastruktur-Explosion

Global geben Unternehmen 2025 geschätzte 375 Milliarden Dollar für KI-Infrastruktur aus, ein Anstieg von 67 Prozent gegenüber dem Vorjahr. Über 61 Milliarden Dollar sind 2025 in den Rechenzentrumsmarkt geflossen, was S&P Global als »globalen Bau-Frenzy« bezeichnet.

Das größte KI-Investment aller Zeiten: das Stargate-Projekt, eine Partnerschaft von OpenAI mit SoftBank und Oracle für etwa 500 Milliarden Dollar, um Rechenzentren zu bauen und Energieversorgung zu sichern. Microsoft allein hat im Fiskaljahr 2025 80 Milliarden Dollar gebunden. Alphabet, Microsoft, Amazon und Meta haben 2024 fast 200 Milliarden Dollar investiert, mit einem erwarteten Anstieg von über 40 Prozent in 2025.

Ein einzelnes KI-Rack kostet durchschnittlich 3,9 Millionen Dollar, fast achtmal so viel wie ein traditionelles Server-Rack mit 500.000 Dollar. Goldman Sachs schätzt, dass etwa 720 Milliarden Dollar an Netzausbau bis 2030 nötig sein könnten, um die Strombedarfe zu decken. Die Wartezeit auf Netzanschlüsse beträgt in einigen Fällen sieben Jahre.

Klimakosten

Googles Treibhausgas-Emissionen sind seit 2019 um 48 Prozent gestiegen, hauptsächlich durch KI-getriebene Rechenzentrums-Expansion. Microsofts Emissionen wuchsen um 29 Prozent seit 2020. Beide Unternehmen haben ihre Klimaneutralitäts-Zusagen aufgegeben oder erheblich modifiziert, da die KI-Anforderungen weiter eskalieren.

Eine Goldman-Sachs-Analyse prognostiziert, dass etwa 60 Prozent des steigenden Strombedarfs von Rechenzentren durch fossile Brennstoffe gedeckt werden, was die globalen Kohlenstoffemissionen um etwa 220 Millionen Tonnen erhöhen würde. Europa schneidet besser ab: Die Kohlenstoffintensität europäischer Stromnetze liegt bei etwa 174 Gramm CO2 pro Kilowattstunde, weniger als die Hälfte des globalen Durchschnitts von 445 und deutlich unter den USA mit 321.

Was getan werden kann

Die Effizienzgewinne sind real. Die Energieeffizienz bei der Inferenz großer Sprachmodelle hat sich in den letzten zehn Jahren um das 100.000-Fache verbessert. Die Rechenleistung pro Joule Energie verbessert sich jährlich um 50 bis 60 Prozent. NVIDIA berichtet eine 24-prozentige Reduktion der verkörperten Kohlenstoffemissionen zwischen HGX H100 und HGX B200.

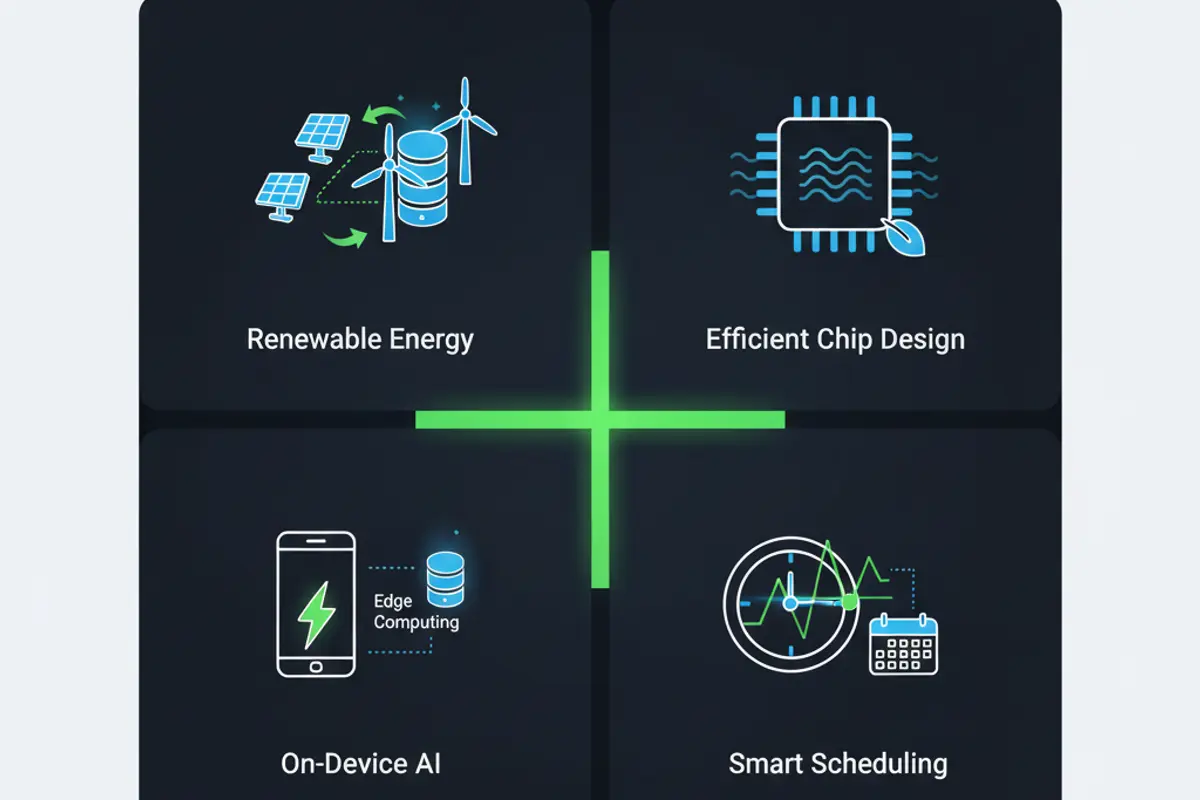

Eine Cornell-Studie skizziert einen Fahrplan: Durch intelligente Standortwahl, schnellere Netz-Dekarbonisierung und operative Effizienz könnten die Auswirkungen um etwa 73 Prozent (CO2) und 86 Prozent (Wasser) gegenüber Worst-Case-Szenarien reduziert werden. Der Mittlere Westen und die »Windgürtel«-Staaten, insbesondere Texas, Montana, Nebraska und South Dakota, würden das beste kombinierte Kohlenstoff-Wasser-Profil bieten.

On-Device-KI, bei der die Verarbeitung direkt auf dem Gerät statt in Cloud-Rechenzentren erfolgt, gilt als vielversprechendste Lösung. Flexibilitätsplattformen, die KI-Workloads mit Netzbedingungen synchronisieren, können die Spitzennachfrage um etwa 40 Prozent reduzieren. Power-Capping von Hardware kann den Energieverbrauch um bis zu 15 Prozent senken, bei nur 3 Prozent längerer Verarbeitungszeit.

Der Rebound-Effekt

Es gibt einen komplexen Zusammenhang durch den »Rebound-Effekt«: Während KI-gesteuerte Fortschritte den Energieverbrauch pro Einheit reduzieren, führen sie oft zu höherem Gesamtverbrauch, was die Umweltvorteile potenziell zunichtemacht. Effizientere Modelle werden mehr genutzt, nicht weniger.

Die optimistische Perspektive: Wenn KI die Energieeffizienz in der breiteren Wirtschaft verbessert, selbst um nur ein Zehntel der Rate ihrer Einführung, könnte der Nettoeffekt energieneutral oder sogar leicht positiv sein. KI hilft bereits Unternehmen, den Energieverbrauch in einigen Fällen um bis zu 60 Prozent zu reduzieren, mit Anwendungsfällen in der Optimierung von Energiespeichern, Batterieeffizienz und Smart-Grid-Management.

Nach Berechnungen des Net-Zero America Project könnten bei vollständiger Einführung von KI-Anwendungen fast 4,5 Prozent des prognostizierten Energiebedarfs 2035 in den drei energieintensivsten Sektoren, Industrie, Transport und Gebäude, eingespart werden.

Fazit: Augen auf

KI hat einen ökologischen Fußabdruck, und er wächst. Die Branche investiert Hunderte Milliarden in Infrastruktur, verbraucht so viel Strom wie mittlere Länder und hat ihre Klimaziele stillschweigend aufgegeben. Gleichzeitig verbessert sich die Effizienz rasant, und KI kann selbst Teil der Lösung sein.

Die Frage ist nicht, ob wir KI nutzen sollten, sondern wie. Standortwahl, Energiequellen, Modelleffizienz und Nutzungsmuster machen den Unterschied zwischen einer Technologie, die den Klimawandel verschärft, und einer, die hilft, ihn zu bekämpfen. Die Daten sind jetzt verfügbar. Die Entscheidungen liegen bei denen, die die Rechenzentren bauen, und bei denen, die sie nutzen.

RAG erklärt: So wird KI faktentreu

Retrieval Augmented Generation (RAG) macht KI vertrauenswürdig. Wie RAG funktioniert, wann es sinnvo

KI in der Bildung: Revolution im Klassenzimmer oder digitale Sackgasse?

92% der Studierenden nutzen KI. Aber verbessert das Lernen? Analyse zu Khanmigo, Turnitin-Problemen