KI-Chips: Der Kampf um die Hardware-Krone

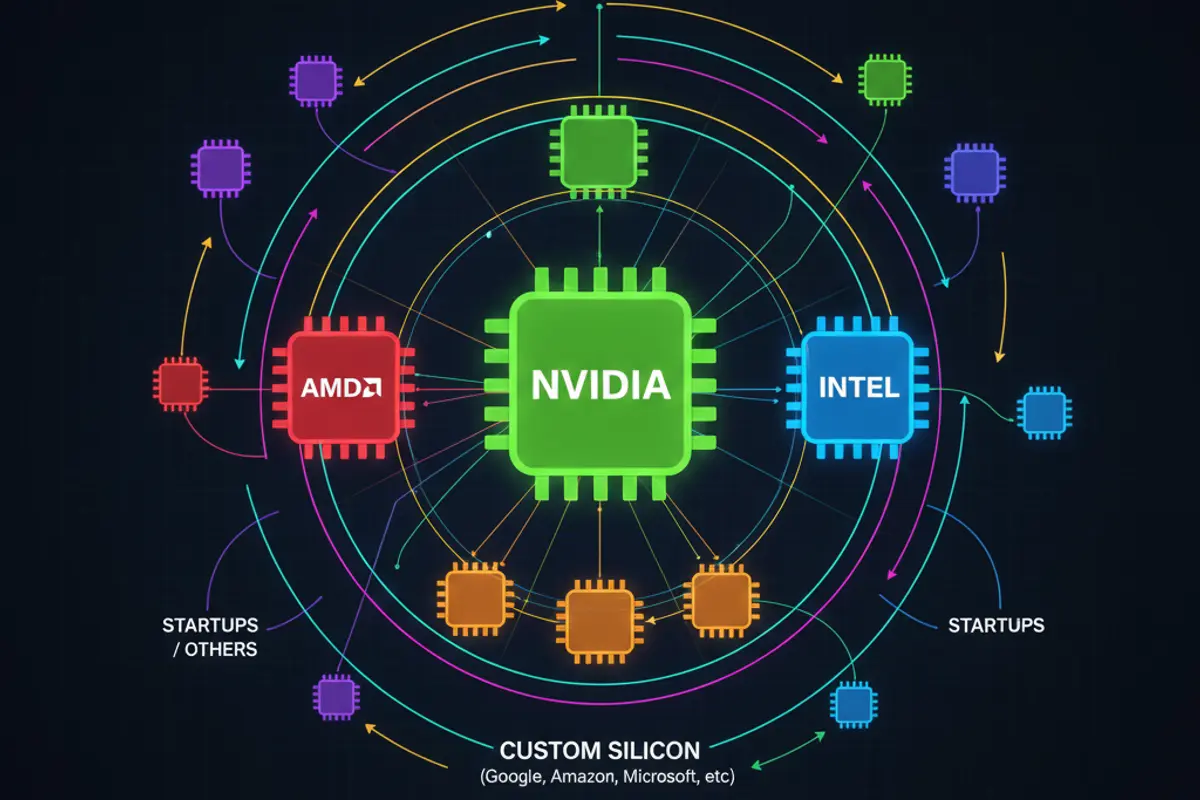

Ende Oktober 2025 überschritt Nvidia erstmals die Marke von 5 Billionen Dollar Marktkapitalisierung. Das Unternehmen, das vor zehn Jahren primär für Gaming-Grafikkarten bekannt war, verdient jetzt mehr als seine beiden größten Konkurrenten AMD und Intel zusammen. Aber die Dominanz hat Risse bekommen, und der Kampf um die KI-Hardware-Zukunft ist offener, als die Zahlen vermuten lassen.

Die Fakten sind beeindruckend: Nvidia kontrolliert je nach Schätzung zwischen 80 und 95 Prozent des Marktes für KI-Beschleuniger. Im dritten Quartal 2025 generierte die Data-Center-Sparte 51,2 Milliarden Dollar Umsatz bei Bruttomargen von über 73 Prozent. Die gesamte Jahresproduktion der Blackwell-Chips war bereits im November 2024 ausverkauft. Das ist keine normale Marktsituation, das ist ein Monopol.

Warum Nvidia dominiert

Die Erklärung liegt nicht nur in der Hardware. Nvidias eigentlicher Wettbewerbsvorteil ist CUDA, eine Software-Plattform, die über fast 20 Jahre aufgebaut wurde. Mehr als 4 Millionen Entwickler arbeiten mit CUDA, über 3.000 optimierte Anwendungen nutzen das Ökosystem, und praktisch jedes bedeutende KI-Framework ist tief integriert. Wer von Nvidia zu einem Konkurrenten wechseln will, muss nicht nur Hardware tauschen, sondern Code umschreiben, Teams umschulen, Workflows neu aufsetzen.

Die Blackwell-Architektur, Nvidias aktuelle Generation, zeigt, wohin die Entwicklung geht: 208 Milliarden Transistoren, zwei Chips verbunden durch einen 10-Terabyte-pro-Sekunde-Interconnect, gefertigt in TSMCs 4NP-Prozess. Die im Dezember 2025 vorgestellte RTX PRO 5000 mit 72 GB Speicher liefert 2.142 TOPS KI-Leistung und ist 3,5-mal schneller bei Bildgenerierung als die Vorgängergeneration. Blackwell Ultra, die nächste Iteration, verspricht 15 Petaflops im NVFP4-Format.

AMD: Der geduldige Herausforderer

AMD ist Nvidias sichtbarster Konkurrent, und 2025 war ein gutes Jahr. Der Aktienkurs hat sich mehr als verdoppelt, besser als Nvidia. Die Data-Center-Sparte wuchs auf 11,2 Milliarden Dollar in den ersten neun Monaten. Sieben der zehn größten KI-Kunden, darunter OpenAI, Meta, Tesla und xAI, nutzen oder planen AMD-Chips.

Der Schlüssel zum AMD-Erfolg ist Inference, also die Ausführung trainierter Modelle. Während Nvidia beim Training dominiert, hat AMD bei Inference einen Kostenvorteil: Laut Cloud-Anbieter RunPod sind AMD MI300X-Chips bis zu 33 Prozent günstiger pro Berechnung als Nvidias H100. Der Inference-Markt wächst mit 48 Prozent jährlich, deutlich schneller als der Trainingsmarkt mit 31 Prozent.

Im Juni 2025 stellte AMD die Instinct MI400-Serie vor, mit Sam Altman von OpenAI auf der Bühne. Die Spezifikationen sind beeindruckend: 432 GB HBM4-Speicher, 40 Petaflops bei FP4, 19,6 Terabyte pro Sekunde Speicherbandbreite. Das »Helios«-Rack-System soll bis zu 72 GPUs als einheitliches System verbinden, mit 260 Terabyte pro Sekunde Scale-Up-Bandbreite. Auslieferung: 2026.

AMDs Strategie unterscheidet sich von Nvidia: offene Standards statt proprietärer Lösungen. Die UALink-Netzwerktechnologie ist Open Source, anders als Nvidias NVLink. Das Versprechen: niedrigere Kosten, weniger Lock-in, mehr Flexibilität.

Die heimlichen Gewinner: Custom Chips

Die größte Bedrohung für Nvidia kommt nicht von AMD, sondern von Nvidias eigenen Kunden. JPMorgan schätzt, dass Custom-Chips von Google, Amazon, Meta und OpenAI bis 2028 45 Prozent des KI-Chip-Marktes ausmachen werden, gegenüber 40 Prozent 2025.

Google hat im September 2025 begonnen, seine TPUs an externe Cloud-Anbieter zu verkaufen. Analyst Gil Luria schätzt den Wert von Googles TPU-Geschäft kombiniert mit DeepMind auf 900 Milliarden Dollar und nennt die TPUs »die beste Alternative zu Nvidia«. Amazon baut mit Project Rainier ein Rechenzentrum mit Hunderttausenden seiner Trainium2-Chips. Meta hat angekündigt, das Chip-Startup Rivos zu übernehmen. OpenAI arbeitet mit Broadcom an eigenen Custom-Chips.

Broadcom selbst ist zum Machtfaktor geworden. Das Unternehmen erwartet 20 Milliarden Dollar KI-Umsatz im laufenden Fiskaljahr, ein Plus von 64 Prozent. Partnerschaften mit OpenAI und Anthropic für Custom-Silizium treiben das Wachstum.

China: Die isolierte Supermacht

China steht vor einem Dilemma. US-Exportkontrollen schränken den Zugang zu Nvidias leistungsfähigsten Chips ein, aber Alternativen sind nicht gleichwertig. 2024 kauften chinesische Unternehmen rund 1 Million Nvidia H20-Chips, die für China zugelassene Variante, aber nur geschätzte 450.000 Huawei Ascend 910B.

Huawei ist der natürliche Ersatz, aber ein Bericht des Council on Foreign Relations kommt zu dem Schluss, dass Huaweis Chip-Fähigkeiten hinter Nvidia zurückbleiben und der Abstand sich nicht verringert, sondern vergrößert. Die Software-Plattform CANN und das Framework MindSpore sind weniger ausgereift als CUDA, mit Berichten über Bugs, Abstürze und Überhitzungsprobleme.

Chinas Strategie setzt auf Masse statt Klasse: riesige Cluster aus Huawei-Chips, subventionierte Energie, staatliche Unterstützung. Baidu hat einen Cluster mit 30.000 Kunlun P800-Chips vorgestellt, die auf dem Niveau von Huaweis 910B und Nvidias A100 liegen. Aber die Lücke zu den neuesten westlichen Chips bleibt erheblich.

Die geopolitische Dimension ist nicht zu unterschätzen. Peking hat begonnen, Nvidias China-kompatible H20-Chips als »unsicher« zu bezeichnen, mit Berichten über versteckte »Backdoors«. Tech-Konzerne wie Alibaba und ByteDance wurden angeblich angewiesen, neue Nvidia-Bestellungen zu stornieren. Der Chip-Krieg eskaliert.

Was kommt als Nächstes

AMD projiziert, dass der gesamte KI-Chip-Markt, inklusive Beschleuniger, CPUs und Networking, bis 2030 auf etwa 1 Billion Dollar anwachsen könnte. Selbst wenn Nvidia die Hälfte seines Marktanteils verliert, könnte der Jahresumsatz im Data-Center-Bereich auf 1 Billion Dollar steigen.

Die Hyperscaler geben 2025 über 380 Milliarden Dollar für KI-Infrastruktur aus. Der Großteil fließt durch Nvidia, aber die Diversifizierung hat begonnen. Custom-Chips, AMD-Alternativen, chinesische Eigenentwicklungen: Das Ökosystem wird vielfältiger.

Für Entwickler und Unternehmen bedeutet das: Die Abhängigkeit von Nvidia lockert sich, aber langsam. CUDA bleibt der Standard, aber Alternativen wie ROCm, Triton und herstellerspezifische SDKs werden reifer. Die Frage ist nicht mehr, ob es Alternativen gibt, sondern wann sie gut genug sind.

Nvidia hat den Kampf um die Hardware-Krone noch lange nicht verloren. Aber zum ersten Mal seit Jahren sieht das Unternehmen echten Wettbewerb. Und in einem Markt, der auf eine Billion Dollar zusteuert, ist Platz für mehr als einen Gewinner.