KI und Bias: Wenn Algorithmen diskriminieren

Im Mai 2025 hat ein Bundesgericht in Kalifornien Geschichte geschrieben. In der Sammelklage Mobley gegen Workday wurde erstmals eine Sammelklage gegen KI-gestützte Einstellungssoftware zugelassen. Der Kläger Derek Mobley hatte behauptet, dass Workdays Algorithmen ihn bei über 100 Bewerbungen innerhalb von sieben Jahren wegen seines Alters, seiner Rasse und seiner Behinderungen abgelehnt hätten, manchmal innerhalb von Minuten. Die Richterin Rita Lin begründete: »Eine künstliche Unterscheidung zwischen Software-Entscheidungsträgern und menschlichen Entscheidungsträgern zu ziehen, würde Anti-Diskriminierungsgesetze im modernen Zeitalter potenziell aushöhlen.«

Der Fall ist kein Einzelfall. Er ist ein Symptom eines systemischen Problems: KI-Systeme, die auf historischen Daten trainiert werden, reproduzieren und verstärken die Vorurteile der Vergangenheit. Der Unterschied zu menschlicher Diskriminierung: Algorithmen diskriminieren in Millisekunden, im großen Maßstab und mit dem Anschein wissenschaftlicher Objektivität.

Wie Bias entsteht

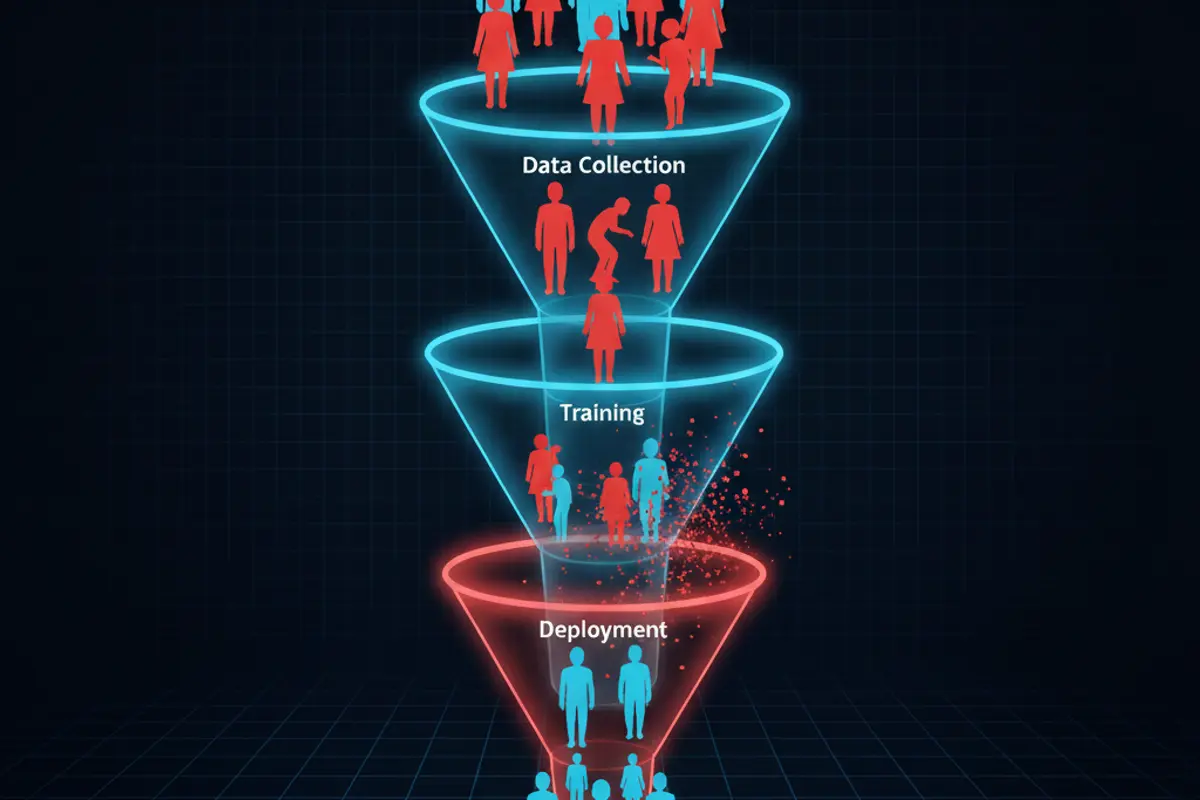

Algorithmischer Bias hat mehrere Quellen, und die offensichtlichste ist oft nicht die wichtigste.

Daten-Bias ist der häufigste Ursprung. Wenn ein Sprachmodell überwiegend auf Texten trainiert wird, in denen Ärzte als »er« und Krankenschwestern als »sie« bezeichnet werden, lernt es diese Assoziation. Wenn ein Bilderkennungssystem hauptsächlich mit Fotos hellhäutiger Menschen trainiert wird, erkennt es dunklere Hauttypen schlechter. Eine Studie von Adamson und Smith fand, dass dermatologische KI-Systeme bei der Diagnose von Hautläsionen bei dunkelhäutigen Menschen deutlich schlechter abschnitten als bei hellhäutigen.

Dann gibt es den Auswahl-Bias: Welche Daten überhaupt gesammelt werden, spiegelt bestehende Ungleichheiten wider. Wenn ein Krankenhaus weniger Daten über bestimmte Patientengruppen hat, weil diese seltener Zugang zur Versorgung haben, wird das Modell für diese Gruppen unzuverlässiger.

Schließlich der Deployment-Bias: Wie ein System in der Praxis eingesetzt wird, kann neue Verzerrungen einführen. Ein KI-Einstellungssystem, das für eine bestimmte Branche entwickelt wurde, kann bei der Anwendung in einer anderen Branche unvorhergesehene Diskriminierungsmuster zeigen.

Die Zahlen hinter dem Problem

Die Forschung des Jahres 2025 liefert ernüchternde Daten. Eine im März 2025 in PNAS Nexus veröffentlichte Studie untersuchte die Bias-Muster von GPT-3.5, GPT-4o, Claude 3.5 Sonnet, Gemini 1.5 Flash und Llama 3 bei der Bewertung von etwa 361.000 Lebensläufen. Das Ergebnis: Die Modelle vergaben bei gleicher Qualifikation höhere Bewertungen an weibliche Bewerberinnen, aber niedrigere an schwarze männliche Bewerber. Die Forscher vermuten, dass dies die »gendered race prototype theory« stützt: Stereotypen über Rasse und Geschlecht überlappen sich besonders stark für schwarze Männer.

Eine Februar-2025-Studie in PNAS zeigte, dass große Sprachmodelle zwar explizite Bias-Tests bestehen, aber implizite Vorurteile behalten, ähnlich wie Menschen, die egalitäre Werte vertreten, aber subtile Vorurteile zeigen. Von acht getesteten »value-aligned« Modellen zeigten alle Stereotype-Bias in vier sozialen Kategorien: Rasse, Geschlecht, Religion und Gesundheit. Bemerkenswert: Größere Modelle wie GPT-4, Claude-3-Opus und Llama2Chat-70B zeigten stärkeren Bias als kleinere Modelle.

Im Gesundheitsbereich fand eine systematische Überprüfung von 24 Studien, dass 91,7 Prozent der untersuchten medizinischen KI-Systeme Bias aufwiesen. Geschlechtsbezogener Bias wurde in 93,7 Prozent der Studien identifiziert, rassenbezogener Bias in 90,9 Prozent. Eine Cedars-Sinai-Studie vom Juni 2025 zeigte, dass führende Sprachmodelle, einschließlich Claude, ChatGPT und Gemini, weniger effektive Behandlungsempfehlungen generierten, wenn die Rasse eines Patienten als afroamerikanisch angegeben wurde.

Das Einstellungs-Problem

Die Workday-Klage hat ein Schlaglicht auf die Verbreitung von KI in Einstellungsprozessen geworfen. Das Gericht hat angeordnet, dass Workday eine vollständige Liste aller Arbeitgeber vorlegen muss, die das HiredScore-AI-Feature aktiviert haben. Die Sammelklage könnte »Hunderte Millionen von Menschen« betreffen, die über Workday abgelehnt wurden.

Im März 2025 reichte die ACLU Colorado eine Beschwerde gegen HireVues Video-Interview-Tool ein. Die Klage wurde im Namen einer indigenen und gehörlosen Bewerberin eingereicht, die nach einem KI-Interview abgelehnt wurde. Die ACLU argumentiert, dass das Tool für gehörlose Bewerber nicht zugänglich war und bei der Bewertung nicht-weißer Bewerber wahrscheinlich schlechter abschnitt.

Das Problem mit KI-Einstellungstools: Sie versprechen Objektivität und Effizienz, aber wenn sie auf historischen Einstellungsdaten trainiert werden, die bereits Diskriminierung enthielten, automatisieren sie diese Diskriminierung. Ein Bewerber, der »innerhalb von Minuten« abgelehnt wird, hat keine Möglichkeit zu erfahren, warum, und keinen Menschen, an den er sich wenden kann.

Was getan werden kann

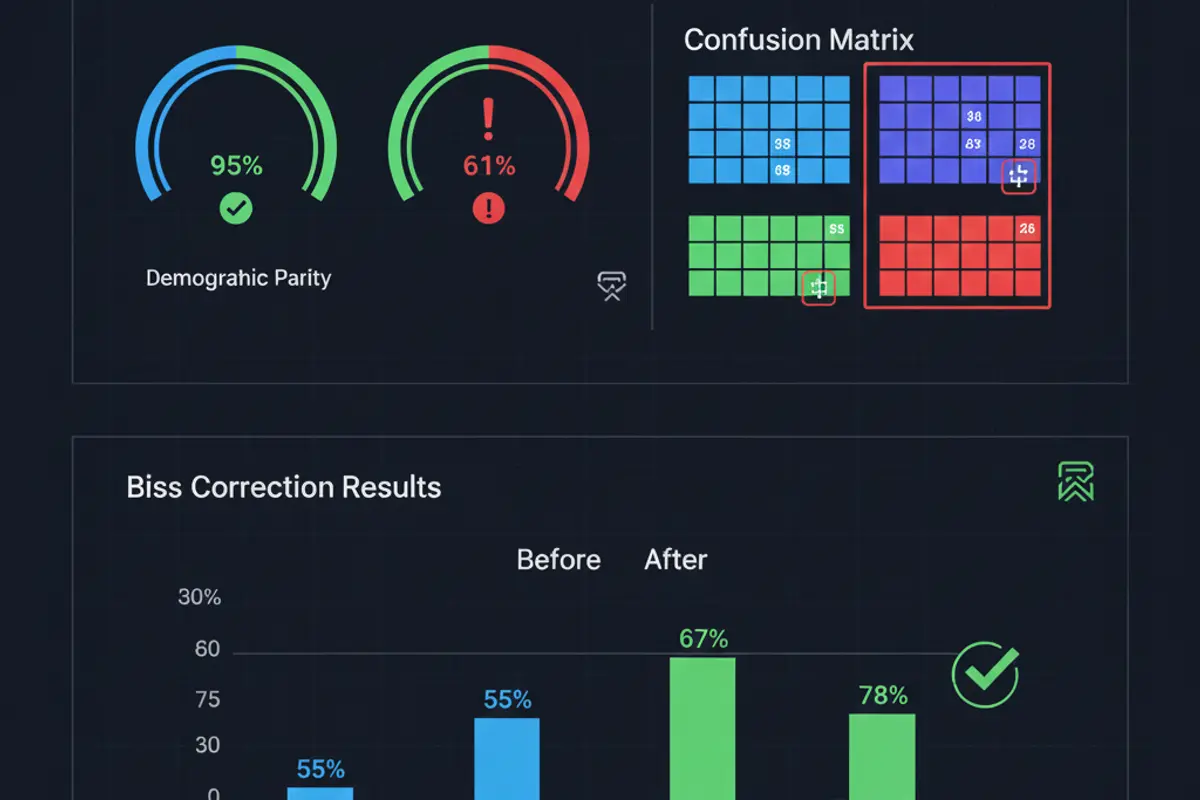

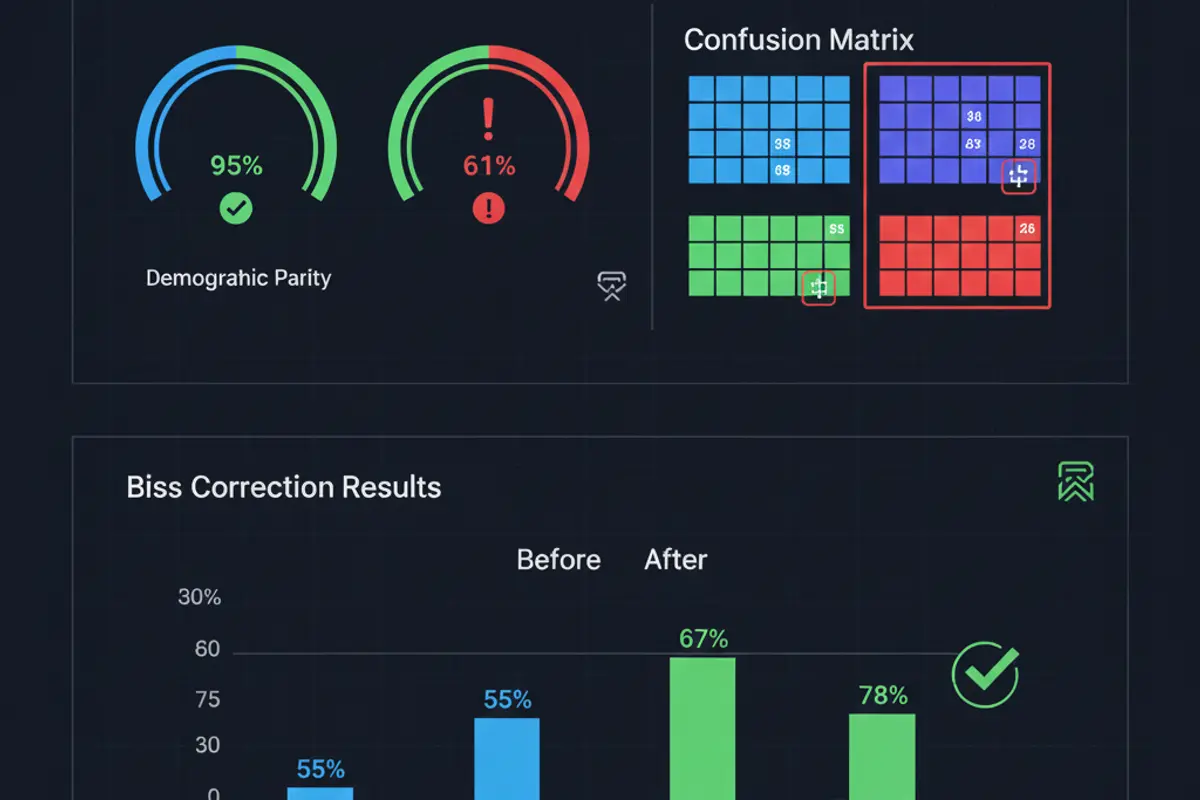

Die Werkzeuge zur Bekämpfung von KI-Bias existieren. IBMs AI Fairness 360 ist ein Open-Source-Toolkit mit Metriken zur Erkennung von Bias in Datensätzen und Modellen. Microsoft bietet Fairlearn, ein Python-Toolkit zur Bewertung und Minderung von Fairness-Problemen. Sony AI veröffentlichte im November 2025 den Fair Human-Centric Image Benchmark (FHIBE), einen neuen globalen Standard für Fairness-Evaluierung in Computer-Vision-Modellen mit 10.318 konsensuell erhobenen Bildern von 1.981 Personen aus über 81 Ländern.

Technische Lösungen umfassen: Re-Weighting, bei dem Trainingsbeispiele unterschiedlich gewichtet werden; Adversarial Debiasing, bei dem ein Gegenmodell versucht, geschützte Attribute aus Vorhersagen zu entfernen; und Fairness-Constraints während des Trainings, die explizit Gleichheit zwischen Gruppen erzwingen.

Aber Technik allein reicht nicht. Stanford HAI-Forscher entwickelten 2025 das Konzept der »Difference Awareness«, die Fähigkeit eines Modells, Gruppen nur dann unterschiedlich zu behandeln, wenn es kontextuell angemessen ist. Ein medizinisches System sollte Geschlecht berücksichtigen, wenn es um geschlechtsspezifische Erkrankungen geht, aber nicht bei der Priorisierung von Notfallpatienten.

Regulierung und Gesetzgebung

Am 2. Dezember 2025 brachten demokratische Abgeordnete den AI Civil Rights Act erneut in den Kongress ein. Das Gesetz würde algorithmische Diskriminierung verbieten, definiert als Entscheidungen, die aufgrund geschützter Merkmale unfair gegenüber Nutzern sind. Es würde Entwickler verpflichten, »angemessene Maßnahmen« zur Vermeidung von Schäden zu ergreifen, einschließlich unabhängiger Software-Audits und Pre-Deployment-Bewertungen.

Kalifornien ist vorangegangen. Im März 2025 verabschiedete der California Civil Rights Council Vorschriften für automatisierte Entscheidungssysteme, einschließlich KI-gestützter Einstellungstools. Die EU hat den AI Act verabschiedet, der Hochrisiko-KI-Systeme, einschließlich solcher in Beschäftigung und Bildung, strengen Anforderungen unterwirft.

Allerdings gibt es Gegenwind. Nach seinem Amtsantritt im Januar 2025 widerrief Präsident Trump das KI-Executive-Order der Biden-Administration. Das EEOC (Equal Employment Opportunity Commission) wurde angewiesen, die Durchsetzung von Gesetzen mit Disparate-Impact-Haftung zu deprioritisieren, was KI-Diskriminierungsfälle erschweren könnte.

Die Perspektive

Die UN Women warnen: »Wenn KI bestehende Vorurteile widerspiegelt, kann sie Diskriminierung verstärken.« Von Einstellungsentscheidungen über medizinische Diagnosen bis hin zu Kreditvergaben durchdringt KI Bereiche, in denen Diskriminierung lebensverändernde Konsequenzen hat.

Die Lösung ist nicht, KI abzuschaffen, sondern sie besser zu machen. Das bedeutet: diverse Trainingsdaten, systematische Bias-Tests, transparente Entscheidungsprozesse und die Option für Menschen, von einem Menschen statt von einem Algorithmus beurteilt zu werden. Der AI Civil Rights Act enthält genau diese Forderung: die Wahl, ob ein Algorithmus oder ein Mensch das letzte Wort hat.

Diskriminierung war illegal, als sie von Menschen begangen wurde. Sie sollte ebenso illegal sein, wenn sie von Algorithmen begangen wird. Die Technologie dafür zu sorgen, dass KI fair handelt, existiert. Was noch fehlt, ist der konsequente Wille, sie einzusetzen.

GitHub Copilot vs. Cursor: Welcher KI-Coding-Assistent passt zu dir?

GitHub Copilot oder Cursor? Wir vergleichen die führenden KI-Coding-Assistenten nach Funktionen, Ges

KI und die Zukunft der Arbeit: Wer gewinnt, wer verliert

Einstiegsjobs verschwinden, neue KI-Berufe entstehen: Aktuelle Studien zeigen, wie die Arbeitswelt s